Szüleik hangjával verik át a gyerekeket a csalók– az MI-t is bevetik

mesterséges intelligenciaPUBLIKÁLÁS: 2026. április 26. 10:30

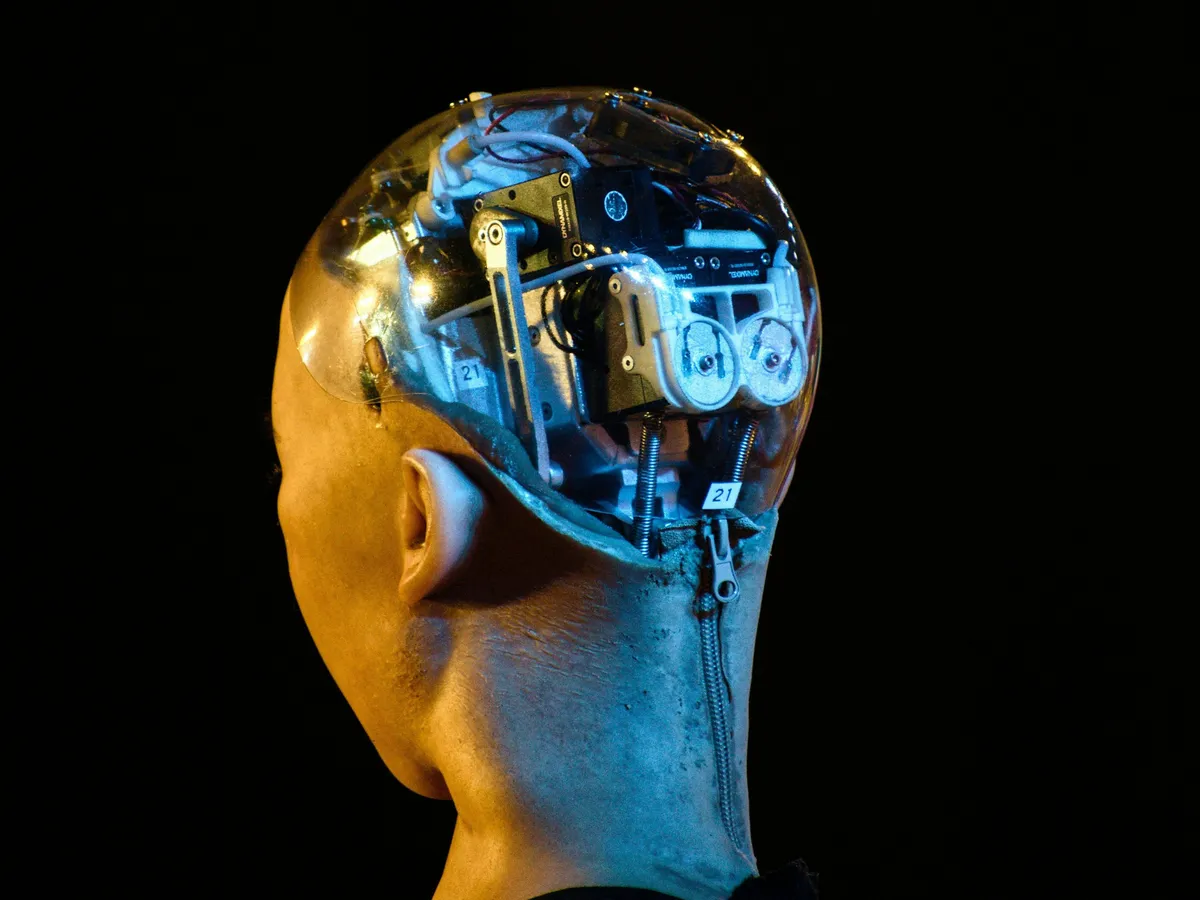

Már nem csak a felnőtteket célozzák az internetes csalók! A mesterséges intelligencia segítségével ma már akár a szülők hangját is képesek lemásolni, hogy megtévesszék a gyerekeket. Tudtad, hogy már néhány másodpercnyi hangminta is elég lehet egy megtévesztően élethű híváshoz? Rácz-Akácosi Attila, AI biztonsági szakértő szerint a tudatosság lehet az egyetlen valódi védelem.

Már nem csak a bankszámláinkra utaznak a csalók! Az alábbi eset arra figyelmeztet, hogy a mesterséges intelligencia segítségével akár már a gyerekeket is célba vehetik.

Fotó: Subhasish Baidya / Pexels

Elég néhány másodpercnyi hangminta, hogy megszerezzék a hangod!

– És mindezt hogyan? – kérdezhetnénk mi, laikusok. Egy könnyű módszerrel, az úgynevezett hangklónozással, ami ma már annyira fejlett, hogy néhány másodpercnyi hangminta is elegendő lehet egy gyermek szüleinek élethű, de hamis hangjának az elkészítéséhez.

A hangklónozás már nem kísérleti technológia, hanem egy könnyen elérhető eszköz, aminek van legitim felhasználása (zenék, podcast, hangoskönyvek), ugyanakkor a csalók számára is új kapukat nyitott. Az Europol külön figyelmeztet arra, hogy az AI-alapú hangklónozás és a deepfake-ek új csalási, zsarolási és személyazonosság-lopási megoldásokat hoztak. Magyarországon bár a nyilvános statisztika még kevés, az online csalások finomodása és az AI-támadások gyorsulása egyértelműen érezhető.

– válaszolta megkeresésünkre nyilatkozva Rácz-Akácosi Attila, mesterséges Intelligencia szakértő/Független AI biztonsági szakértő.

Hogy miért foglalkozunk a témával? A mesterséges intelligencia terjedése miatt!

A napokban egy amerikai édesapa az egyik TikTok videójában arról számolt be, hogy a csalók immár képesek lehetnek arra, hogy a szülők hangját lemásolva próbálják rávenni a gyerekeket arra, hogy:

- ajtót nyissanak egy idegennek,

- vagy más, bizalmas információkat adjanak ki a családtagjaikról.

Ez pedig nem csoda. Ahogy a szakértő is említette, a technológia fejlődése az elmúlt években elképesztő tempót diktált és ma már nem szükséges több órányi hosszúságú felvétel egy személy hangjának leklónozásához.

A McAfee kutatása szerint mindössze 3 másodperc tiszta hanganyag elegendő egy 85%-os pontosságú, élethű klónhoz. A bűnözőknek kreatívnak sem kell lenniük: bőven elég egy TikTok-videó, egy Instagram-történet vagy egy egyszerű hangüzenet, hogy a technológia reprodukálja valaki hangszínét és beszédritmusát, még ha nem is tökéletesen.

– mondta lapunknak.

Szóval, legyünk óvatosak, mert egy ilyen mintát elég könnyen megszerezhetnek a csalók. Elég egy gyanútlan telefonhívás, vagy egy közösségi médiába feltöltött videó.

S hát, miután a csalók megszerezték a hangmintát, speciális szoftverekkel képesek új mondatokat generálni az adott személy hangján. Így akár egy szülő hangján is megszólalhat valaki a telefonon keresztül.

Nem kell hackernek lenni: az ún. „Scam-as-a-Service” (Csalás mint Szolgáltatás) modellekkel percek alatt készíthető profi hangklón. Míg korábban ehhez komoly tudás kellett, ma már havi 60 dollárért (kb. 22 000 Ft) teljes körű, automatizált csaló „vállalkozást” lehet üzemeltetni deepfake videóval és hamis weboldalakkal.

– tette hozzá a szakértő.

A megtévesztés pedig még ennél is ijesztőbbé válhat, ha még a hívószám is hitelesnek tűnik. A csalók ugyanis arra is képesek lehetnek, hogy a hívószámot-hamisítsák, és ennek során a telefon kijelzőjén valóban az édesanya vagy édesapa neve jelenik majd meg.

Ha mindehhez hozzávesszük az esetleges hívószám-hamisítást: a gyermek telefonján valóban az apa vagy az anya neve és száma jelenik meg. Ehhez hozzáadódik a szülő klónozott hangja… belegondolni is ijesztő a lehetséges kimenetelbe. Egy átlagembernek hosszú másodpercekig esélytelen felismerni a csalást.

– árulta el Rácz-Akácosi Attila, aki ezek után rátért a védekezésre.

Hiszen gondolhatjuk magunkban, hogy akkor mi lehet a megoldás? Mint kiderült, érdemes egy titkos kódszót bevezetni, amelyet csak a családtagok ismernek, így egy gyanús hívás esetén könnyen kiszűrhető lehet a csaló.

A leghatékonyabb védelem a családi biztonsági jelszó és az azonnali visszahívás egy másik csatornán! – javasolta a szakértő.

Érdemes viszont megjegyezni, hogy ilyen helyzetekben a csalók gyakran sürgető, félelmet keltő üzeneteket használnak. Például azt állíthatják, hogy valami baj történt, és azonnali segítségre van szükségük, vagy arra kérhetik a gyermeket, hogy nyissa ki az ajtót egy futárnak.

Árulkodó jelek lehetnek az

● érzelmi nyomás és folyamatos sürgetés: Most azonnal utalj, különben nagyon nagy baj lesz!", „Ne hívj fel senki mást!"

● A szokatlan kérések: készpénz átadása ismeretlen futárnak, kriptovaluta-utalás, azonnali Revolut- vagy Wise-átutalás ismeretlen számlára.

● Vagy a természetellenes reakciók. Az AI-rendszerek gyakran késnek 1-2 másodpercet a válasszal, a hangszín lehet túl közömbös vagy túl egyenletes (nincs benne természetes szünet), és nem reagál spontán közbeszólásra, kérdésre.

– adott pár tanácsot a szakértő.

A szakértő szerint az AI-alapú csalások ilyen mértékű terjedése azt jelzi, hogy az online világ veszélyei egyre inkább átszivárognak a mindennapokba. Tehát, ami korábban csak a filmekben létezett, ma már valós fenyegetéssé válhat.

Beléptünk a multimodális csalások világába: a hanghoz már valós idejű videó-deepfake is társul érzelmi kifejezésekkel. Egy Meet vagy Messenger-hívásban nemcsak hallani, de látni is fogjuk a „szerettünket". A Sophos 2026-os előrejelzése szerint autonóm AI-ügynökök fognak ezerszámra telefonálni, miközben élőben tanulnak az áldozatok reakcióiból. A legfontosabb tanulság: nem a technológia, hanem a saját érzelmi reflexeink ellen kell megtanulnunk védekezni!

– zárta szavait Rácz-Akácosi Attila.

Éppen ezért egyre fontosabb, hogy a családok beszéljenek ezekről a kockázatokról, és felkészítsék a gyerekeket a digitális korszak új veszélyeire. A mesterséges intelligencia rengeteg lehetőséget kínál, de rossz kezekben komoly fegyverré is válhat – különösen akkor, ha a legkisebbeket célozzák meg vele.

A legfrissebb hírekért kövess minket a Bors Google News oldalán is!

Portfóliónk minőségi tartalmat jelent minden olvasó számára. Egyedülálló elérést, országos lefedettséget és változatos megjelenési lehetőséget biztosít. Folyamatosan keressük az új irányokat és fejlődési lehetőségeket. Ez jövőnk záloga.

Bács-Kiskun - baon.hu Baranya - bama.hu Békés - beol.hu Borsod-Abaúj-Zemplén - boon.hu Csongrád - delmagyar.hu Dunaújváros - duol.hu Fejér - feol.hu Győr-Moson-Sopron - kisalfold.hu Hajdú-Bihar - haon.hu Heves - heol.hu Jász-Nagykun-Szolnok - szoljon.hu Komárom-Esztergom - kemma.hu Nógrád - nool.hu Somogy - sonline.hu Szabolcs-Szatmár-Bereg - szon.hu Tolna - teol.hu Vas - vaol.hu Veszprém - veol.hu Zala - zaol.hu

Bács-Kiskun - baon.hu Baranya - bama.hu Békés - beol.hu Borsod-Abaúj-Zemplén - boon.hu Csongrád - delmagyar.hu Dunaújváros - duol.hu Fejér - feol.hu Győr-Moson-Sopron - kisalfold.hu Hajdú-Bihar - haon.hu Heves - heol.hu Jász-Nagykun-Szolnok - szoljon.hu Komárom-Esztergom - kemma.hu Nógrád - nool.hu Somogy - sonline.hu Szabolcs-Szatmár-Bereg - szon.hu Tolna - teol.hu Vas - vaol.hu Veszprém - veol.hu Zala - zaol.hu